少样本提示词(few-show-prompt)

少样本提示(Few-shot Prompting)是一种用于大语言模型(LLM)的技术,通过提供少量示例来引导模型生成更符合预期的输出。这种方法在处理复杂任务时相较于零样本提示(Zero-shot Prompting)表现更佳,有时候会出现事半功倍的效果,因为它为模型提供了上下文和具体的示例,有助于模型理解用户的需求。

定义与原理

少样本提示的核心在于通过给定一小部分示例,帮助模型在特定任务上进行学习和推理。与零样本提示不同,后者不提供任何示例,完全依赖模型的预训练知识。例如,在少样本提示中,可以提供一个新词的定义及其使用示例,以帮助模型理解如何在句子中正确使用该词[1][2][3]。

应用场景

少样本提示适用于多种场景,尤其是那些需要特定领域知识或复杂推理的任务。以下是一些典型应用:

- 语言生成:通过提供语境和示例,改善文本生成的质量。

- 情感分析:使用标记示例帮助模型识别文本中的情感倾向。

- 特定领域任务:如法律、医学等领域,可以通过少量高质量示例来提高输出的准确性[3][4].

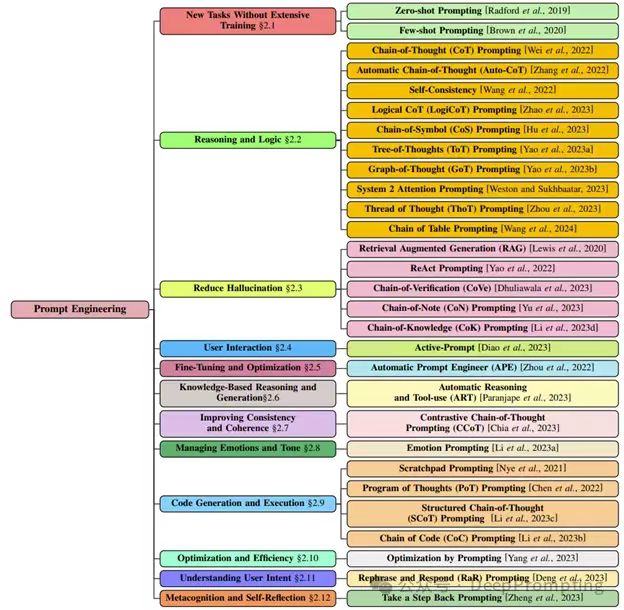

少样本或多样本提示词已经成为其他提示词工程的基础,比如思维链提示词就是通过少样本演变来的提示词工程技术,除了思维链提示词,其他提示词技术都涉及到提供示例来引导大模型输出更加准确可控的信息。

另外当我们使用提示词工程相关的技术应用到编程领域时,可以通过少样本提示词,精确的控制模型的输出,这样的话,程序就可以很容易的解析输出格式,增强软件的鲁棒性。

技巧与注意事项

在实施少样本提示时,有几个技巧可以提高效果:

- 使用标签:在示例中添加标签可以帮助模型更好地理解任务要求,即使标签格式不统一也能有效提升性能[1][2]。

- 多样性与质量:所提供示例的多样性和质量直接影响模型的输出效果。垃圾进则垃圾出,低质量的示例可能导致错误的结果[3][4]。

- 思维链技术:结合思维链(Chain of Thought)提示,可以引导模型进行逻辑推理,从而提高复杂问题的回答准确性[4][5].

局限性

尽管少样本提示具有许多优点,但它也存在一些局限性:

- 依赖于示例质量:如果提供的示例不够清晰或相关,可能会导致模型输出不准确或不相关的信息。

- 过拟合风险:模型可能会过度依赖给定的示例,而无法泛化到新的、未见过的情况[2][3]。

总之,少样本提示是一种强大的工具,可以显著提升大语言模型在复杂任务中的表现,但成功实施这一技术需要精心设计和选择高质量的示例。

少样本提示词的一些实例:

- JSON格式输出:

输入: 创建一个包含姓名和年龄的人员信息

输出:

{

"name": "张三",

"age": 30

}

输入: 创建一个包含书名和作者的图书信息

输出:

{

"title": "三体",

"author": "刘慈欣"

}

输入: 创建一个包含产品名称和价格的商品信息

输出:- 函数定义格式:

输入: 创建一个计算两数之和的Python函数

输出:

def add_numbers(a, b):

return a + b

输入: 创建一个判断字符串是否为回文的Python函数

输出:

def is_palindrome(s):

return s == s[::-1]

输入: 创建一个计算给定数字阶乘的Python函数

输出:

- SQL查询格式:

输入: 从users表中选择所有用户的名字和邮箱

输出:

SELECT name, email FROM users;

输入: 从products表中选择价格高于100的所有产品

输出:

SELECT * FROM products WHERE price > 100;

输入: 从orders表中选择2023年1月1日之后的所有订单

输出:- HTML模板格式:

输入: 创建一个包含标题和段落的HTML结构

输出:

<div class="content">

<h1>标题</h1>

<p>这是一个段落。</p>

</div>

输入: 创建一个包含图片和描述的HTML结构

输出:

<figure>

<img src="image.jpg" alt="描述">

<figcaption>图片描述</figcaption>

</figure>

输入: 创建一个包含无序列表的HTML结构

输出:这些例子展示了如何使用少样本提示来指导AI生成特定格式的代码或输出。通过提供一两个例子,AI可以学习并推断出所需的格式和结构。

参考文章

[1] https://www.sohu.com/a/788035576_120635785

[2] https://www.promptingguide.ai/zh/techniques/fewshot

[3] https://www.53ai.com/news/qianyanjishu/2024061397638.html

[4] https://learn.tishi.top/docs/advanced/few-shot-prompting/

[5] https://www.woshipm.com/share/6111304.html

[6] https://sspai.com/post/91879

[7] https://v2-ai.tutorial.hogwarts.ceshiren.com/ai/aigc/L2/tutorial/%E5%B0%91%E6%A0%B7%E6%9C%AC%E6%8F%90%E7%A4%BA/

[8] https://cloud.baidu.com/qianfandev/topic/267310

[9] https://www.promptingguide.ai/techniques/fewshot

[10] https://www.prompthub.us/blog/the-few-shot-prompting-guide